Wie klug kann Künstliche Intelligenz wirklich sein, wenn sie veraltete und ungerechte Daten verwendet? Können wir ohne KI leben? Und wie können Roboter feministischer denken und die Welt gerechter machen? Die Wirtschaftsinformatikerin Eva Gengler hat genau darüber ein Buch geschrieben.

Von Mareike Graepel, Haltern

Zusammenfassung:

Eva Gengler zeigt, wie KI bestehende Machtstrukturen reproduziert – weil sie mit verzerrten, männlich geprägten Daten trainiert wird. Ob Recruiting, Gesichtserkennung oder Sexroboter: Diskriminierung wird oft automatisiert. Doch die Wirtschaftsinformatikerin sieht eine Chance: Feministische KI soll vielfältiger gedacht, gerechter programmiert und verantwortungsvoll reguliert werden. Entscheidend ist, wer sie gestaltet – und mit welchem Bewusstsein für Macht und Gleichberechtigung.

Wo begegnet uns Künstliche Intelligenz – ist KI schon überall?

Jede*r kennt KI aus dem Alltag: Gesichtserkennung oder Fingerabdrucksensoren am Handy, Navigationssysteme wie Google Maps, die uns die schnellste oder energiesparendste Route berechnen oder vor Staus warnen. Spotify oder Netflix schlagen uns Musik oder Filme auf Basis dessen vor, was sie „denken“, was uns interessieren könnte. Auch Filter auf dem Smartphone, Rechtschreibprüfungen oder Wortvervollständigungen beruhen auf KI. Das sind Alltagsanwendungen, die viele nicht als KI wahrnehmen.

Gleichzeitig wird KI in tiefgreifenden Bereichen eingesetzt – in der Überwachung durch Gesichtserkennung, in den USA oder in China, bei Kreditentscheidungen oder im Recruiting, wenn entschieden wird, welche Jobs mir angezeigt werden. Wenn wir von KI-Systemen sprechen, denken die meisten Menschen aber an generative KI, an Systeme mit denen Texte, Bilder oder Videos erstellt oder verändert werden können.

I Foto: StMAS / Monika Keiler

Viele Menschen denken, KI kann viel, aber es gibt auch die Sorge, dass Vorurteile durch KI verstärkt werden, sie diskriminierend und rassistisch sei. Woran liegt das?

Ich habe 2018 und 2019 meine Masterarbeit zu ethischen Implikationen von Recruiting geschrieben, und mit so einem Thema wird klar: KI entscheidet auf Basis der Daten, mit denen wir sie füttern. Es gibt Studien, die zeigen, dass wir Computern eine höhere Objektivität zuschreiben als Menschen. Wir denken oft, KI sei neutral, wie ein Taschenrechner, der rechnet etwas aus – ohne Wertung. Aber viele Entscheidungen haben kein klares „richtig“ oder „falsch“. Es hängt vielmehr vom Kontext und der Perspektive ab.

Im Recruiting sehen wir strukturelle Ungerechtigkeiten: Frauen werden seltener in Führungspositionen eingestellt, verdienen weniger Geld und bekommen seltener IT-Jobs. Wir wissen, dass Menschen nicht objektiv entscheiden. KI lernt aus historischen Entscheidungen. Wenn wir Prozesse automatisieren, reproduzieren wir diese Ungerechtigkeiten. Die Machtstrukturen bleiben bestehen – effizienter. Ende 2025 habe ich meine Promotion abgeschlossen. Ich habe untersucht, wie KI Ungerechtigkeit verstärkt, warum das so ist und wie wir das feministisch verändern können.

Kann KI trotzdem helfen, gerechtere Entscheidungen zu treffen?

Das ist meine Überzeugung. Dafür müssen wir erkennen, wie vorurteilsbehaftet wir handeln. Viele Menschen reagieren defensiv, wenn ihnen Rassismus oder Sexismus vorgeworfen wird, weil sie sich nicht so sehen wollen. Die meisten wollen gute Entscheidungen treffen. KI kann eine Chance sein, weil sie Muster sichtbar macht und uns den Spiegel vorhalten kann. Sie kann helfen, objektiver und schneller zu entscheiden – wenn wir sie bewusst gestalten. Wenn wir Vergangenes nachahmen, wird sich nichts ändern. Firmen haben ein monetäres Interesse daran, etwas zu ändern, aber das setzt Bereitschaft zur Selbstreflexion voraus: zu erkennen, dass etwas schief gelaufen ist und dass KI eine Chance sein kann, diese Schieflage auszugleichen.

Mehr über Eva Gengler:

Eva Gengler ist Wirtschaftsinformatikerin und forscht intersektional-feministisch zu Machtstrukturen und Künstlicher Intelligenz. Sie promovierte in Erlangen-Nürnberg mit einer Dissertation darüber, wie KI sowohl Unterdrückung verstärken als auch zur Stärkung marginalisierter Gruppen beitragen kann. Ihre Forschung analysiert insbesondere, wie KI durch Regulierung, Governance und neue Denkansätze gerechter gestaltet werden kann. Sie ist eine gefragte Speakerin und hat über 100 Vorträge, Workshops und Keynotes zu KI, Macht und Gendergerechtigkeit gehalten.

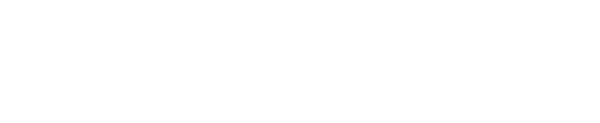

Von der KI reproduziert: Wie sich Macht zusammensetzt. I Illustration: Jan Hendrik Ax

Welche Rolle spielen da Daten, Macht und Kontext?

Daten sind nicht neutral. Sie werden von Menschen ausgewählt, bewertet und kuratiert. Diejenigen, die KI entwickeln und trainieren, sind häufig Männer, weiß und aus privilegierten Verhältnissen. Diese relative Homogenität prägt, welche Daten genutzt werden und welche Perspektiven fehlen. Hinzu kommt der Kontext: Eine KI, die in den USA entwickelt wird, funktioniert nicht automatisch in Deutschland, China oder Afrika gut.

Gesichtserkennungssysteme erkennen weiße männliche Gesichter am besten und Schwarze weibliche am schlechtesten. Das kann je nach Anwendungsfall zu Problemen führen. Dieselbe Technologie kann unterschiedlich eingesetzt werden – zur Bequemlichkeit oder zur Überwachung. Deshalb müssen wir fragen: Wer hat diese KI gebaut, für wen und zu welchem Zweck? Das bringt uns zur Macht. Nicht alle Menschen haben gleich viel Macht, wenn es um die Entwicklung und den Einsatz von KI geht, aber fast alle sind betroffen.

Du hast dich beruflich mit Robotern im Alltag beschäftigt – in der Pflege und in der Sexualität. Wo liegen da die ethischen Fragen und Zweifel?

In der Pflege kann Technologie zum Beispiel bei körperlich schweren Tätigkeiten entlasten. Viele Pflegekräfte leiden darunter, dass sie kaum Zeit für zwischenmenschliche Zuwendung haben. Meine Utopie wäre, dass Technik dazu beiträgt, mehr Zeit für echte Beziehungen zu schaffen. KI kann keine menschliche Bindung ersetzen. Bei Sexrobotern wird es komplex. Wir haben ein Bedürfnis nach emotionaler und körperlicher Nähe.

Bei Sexrobotern sehen wir, dass sie vom sogenannten „Male Gaze“ – also der Darstellung von Frauen aus der Perspektive eines heterosexuellen Mannes – geprägt sind: hypersexualisierte weiblich-gelesene Körper, wenig Diversität. Sie sind verfügbar, sagen nicht Nein. Die Sorge vieler Forscher*innen und Aktivist*innen ist, dass dies die Objektifizierung von Frauen verstärkt und sich langfristig auf reale Beziehungen übertragen könnte.

Du sagst, eine „Feministische KI“ wäre nötig – was ist das konkret?

Immer wieder stoße ich auf das Missverständnis, dass meine Arbeit an feministischer KI bedeuten würde, ich arbeite an „der einen“ feministischen KI. Als würde ich in einem Labor sitzen und an einem geheimen Projekt tüfteln, das „die feministische KI“ hervorbringt. Ich versuche, einen Ansatz zu entwickeln, der es möglich macht, alle KI-Systeme feministischer zu gestalten und zu nutzen. Es geht um eine grundlegende Veränderung der Denkweise, Gestaltung und Nutzung rund um KI.

Dafür gibt es schon jetzt Beispiele: „myProtectify“ entwickelt mit Maya einen Hilfe-Chat zur emotionalen Unterstützung Betroffener von Gewalterfahrungen. „FAIR_solution“ soll Gaps in Bezug auf Bezahlung, Karrierechancen, Arbeitszeit und Weiterbildung in Unternehmen aufdecken und Lösungen anstoßen. Mit „COCO“ soll ein KI-Tool zur Bildgenerierung jenseits von Stereotypen, Vorurteilen und Klischees entstehen, das Prompting neu denkt und Diversität zum Standard macht.

Wie kann man Kindern einen kritischen und bewussten Umgang mit KI vermitteln?

Das ist eine gesamtgesellschaftliche Aufgabe. Es geht um Offenheit, Respekt und Vielfalt – in Bildung, Medien und mit Vorbildern. Kinder müssen lernen, Zusammenhänge zu hinterfragen: Warum sehe ich diesen Inhalt? Wer entscheidet das? Auch bei KI ist wichtig zu verstehen, was sie kann und wo ihre Grenzen liegen. Texte können überzeugend klingen, ohne wahr zu sein. Deshalb müssen wir lernen, KI-generierte Informationen als solche zu identifizieren. Gleichzeitig sollten Kinder lernen, dass sie nicht machtlos sind. Wir haben Einfluss darauf, welche Technologien wir nutzen, welche Daten wir teilen und welche wir kritisch hinterfragen.

Welche Aufgaben haben Politik und Wirtschaft in diesem Zusammenhang?

Sie tragen Verantwortung. Die Politik muss einen rechtlichen Rahmen schaffen, der uns vor problematischem KI-Einsatz schützt. Der „EU AI Act“ ist ein erster Schritt, aber es geht mehr. Die Politik sollte Fördergelder an intersektionale Perspektiven binden und feministische KI-Anwendungen fördern. Sie ist zuständig, dass die Bevölkerung die notwendige Bildung zu KI, also KI-Kompetenz, flächendeckend wie kritisch erwirbt. Das Management in Firmen trägt die Verantwortung, den gesetzlichen Vorgaben gerecht zu werden und eine verantwortungsvolle KI-Kontrolle einzuführen, die über die Einhaltung hinausgeht und Kriterien wie ökologische Nachhaltigkeit und gesellschaftliche Konsequenzen in Entscheidungen zu KI einbezieht. Wo Macht ist, liegt Verantwortung. Diese Verantwortlichkeit sehen wir zu selten.

I Illustration: Jan Hendrik Ax

Wie siehst du die Entwicklung auf dem Big-Tech-Giganten-„Spielplatz“, wo im Interesse des amtierenden US-Präsidenten Donald Trump Diversitätsregeln und Faktenchecks über Bord geworfen werden?

Ich sehe das kritisch. Die US-Regierung schafft ein Umfeld der Deregulierung ohne Rücksicht auf Verluste. Zudem werden Datensätze manipuliert und gelöscht, zur Klimakrise, Rassismus und DEI, Vorgaben für „Diversity, Equity, and Inclusion“. Das ist ein fatales Signal für zukünftige Trainings von KI. Dabei üben die US-Regierung und die Big-Tech-Giganten aus den USA Druck auf die EU und deren regulatorische Vorhaben aus. Wir sehen viele mächtige Männer mit fragwürdigen bis rechtsextremen Einstellungen, die positive Entwicklungen der letzten Jahre zunichtemachen. Die Macht des US-amerikanischen Präsidenten und der großen US-Tech-Firmen ist eine gefährliche Mischung.

Glaubst du, dass wir als Gesellschaft KI und digitalen Fortschritt für Frauen und marginalisierte Gruppen gestalten und verbessern können?

Mir ist bei der Durchsicht meiner Forschung der letzten Jahre und meiner Dissertation aufgefallen, dass wir massive Rückschritte gemacht haben. Ich sehe ein Risiko, aber auch feministische KI-Initiativen in Forschung, Gesellschaft, Politik und Wirtschaft, die in ihrem Kontext etwas verändern können. Ich denke, wir stehen an einem Wendepunkt: KI kann zu mehr Ungerechtigkeit oder zu mehr Empowerment beitragen. Der entscheidende Faktor sind wir Menschen – nicht die Technik, nicht die KI.

Woran arbeitest du aktuell konkret?

Ich halte Vorträge rund um Feministische KI in Wirtschaft, Gesellschaft, Wissenschaft und Politik. Außerdem beschäftige ich mich in Studien mit KI und Menschenrechten, KI-Governance in Unternehmen und mit Feministischer KI. Und ich leite eine feministische „Artificial Intelligence Community“, wo es um KI-Systeme wie „Grok“ (von Elon Musks „X“, ehemals Twitter) und deren Systemprompts geht.

Weitere Infos:

Das Buch „Feministische KI – Meine Vision für eine gerechtere Welt“ von Eva Gengler erscheint im März im J.H.W. Dietz Verlag und kann hier vorbestellt werden: https://www.feministische-ki.de/. Die Community, die Eva Gengler aufbaut, findet sich hier: https://www.skool.com/feminist-ai-for-more-equity